Envie de gagner du temps ?

Faites résumer cet article par l’IA en quelques secondes.

1. Introduction : la fin de la narration « à suspense »

Pendant deux décennies, l’écosystème SEO a été dominé par le paradigme du « guide ultime » : des piliers de 2 000 mots conçus pour piéger l’attention humaine. Nous avons perfectionné l’art de l’introduction narrative, distillant les informations avec parcimonie pour ne révéler la valeur stratégique qu’en fin d’article, juste avant l’appel à l’action.

Ce modèle est désormais structurellement obsolète. L’analyse massive de 1,2 million de réponses générées par ChatGPT révèle que l’IA ne se comporte pas comme un lecteur curieux, mais comme un éditeur de presse sous pression. Elle ne parcourt pas votre prose pour le plaisir ; elle l’audite pour optimiser son ratio information-token. Pour survivre à cette transformation AIT (AI-Integrated Transformation), les créateurs de contenu doivent abandonner la narration littéraire au profit d’une efficacité chirurgicale.

2. La courbe du « tremplin » : pourquoi les 30 % initiaux sont cruciaux

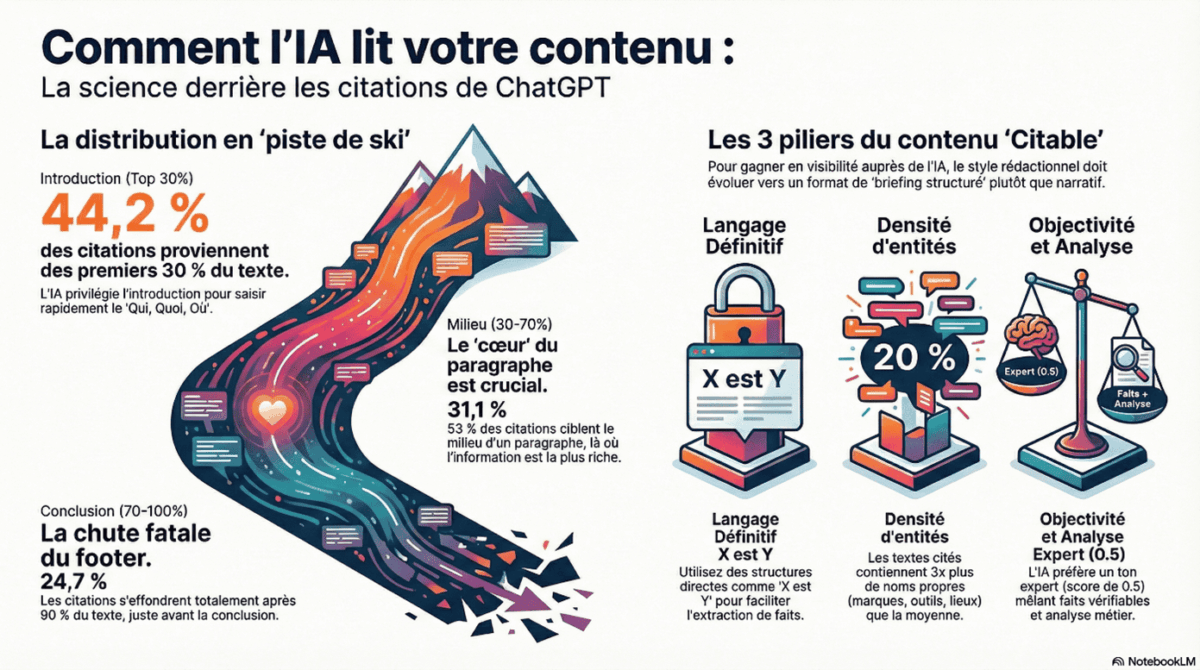

L’étude des citations identifie un motif systématique baptisé par Kevin Indig la distribution en « tremplin » (ski ramp). L’IA accorde une pondération vectorielle disproportionnée au premier tiers de votre contenu.

Les statistiques de citation sont sans appel :

- 44,2 % des citations proviennent des premiers 30 % du texte.

- 31,1 % des citations sont extraites du milieu du texte (30 % à 70 %).

- 24,7 % des citations seulement survivent dans le dernier tiers.

Cette préférence s’explique par l’architecture même des Large Language Models (LLM). Formés sur des corpus journalistiques et académiques, les modèles privilégient la structure BLUF (Bottom Line Up Front).

« Alors que les modèles modernes peuvent traiter jusqu’à 1 million de tokens, ils cherchent à établir le cadre sémantique le plus vite possible, puis interprètent tout le reste à travers ce cadre. »

Si votre proposition de valeur est enfouie au dixième paragraphe, l’IA est statistiquement 2,5 fois moins susceptible de vous citer. Elle exige que vous définissiez le périmètre de votre expertise dès les premières lignes.

3. Au-delà du premier regard : la quête du « gain d’information »

Une idée reçue voudrait que l’IA soit « paresseuse » et se contente de la première phrase de chaque paragraphe. Les données infirment cette thèse : 53 % des citations proviennent du milieu d’un paragraphe, contre 24,5 % pour l’attaque et 22,5 % pour la conclusion de la section.

L’IA pratique une lecture profonde axée sur le gain d’information (information gain). Elle traque les segments qui apportent une valeur additive et expansive par rapport au reste du Web. Elle ignore le « remplissage » pour se concentrer sur les phrases denses en entités. Cela signifie que chaque phrase au cœur de vos paragraphes doit fonctionner comme une unité d’information autonome et riche. La dilution n’est plus une simple faiblesse stylistique ; c’est un signal de faible autorité pour l’algorithme.

4. Le pouvoir du langage définitif et de la résolution « Zero-Shot »

Pour être indexé et cité, votre langage doit agir comme une ancre probabiliste. Les contenus utilisant un ton définitif (« X est… », « se définit par… ») affichent un taux de citation de 36,2 %, contre seulement 20,2 % pour les formulations évasives.

Techniquement, dans une base de données vectorielle, le verbe « être » crée un pont sémantique direct. L’IA privilégie ces structures car elles permettent une résolution « Zero-Shot » : la capacité de répondre à la requête de l’utilisateur en une seule étape d’extraction, sans avoir à synthétiser péniblement cinq paragraphes disparates.

La stratégie la plus efficace repose sur l’utilisation des balises H2 comme des invites (prompts) et l’application de l’écho d’entité.

Comparaison des structures de performance :

| Structure | Approche « perdante » (Vague) | Approche « gagnante » (Directe) |

| Ton | « Dans un monde qui change, l’automatisation devient clé… » | « L’automatisation des démos est le processus consistant à… » |

| Structure H2 | L’histoire du SEO (Sujet abstrait) | Quand le SEO a-t-il commencé ? (Requête littérale) |

| Réponse | « Cela a commencé au début des années 90… » | « Le SEO a commencé en… » (Écho d’entité) |

5. La densité d’entités et le paradoxe de la précision

Alors qu’un texte standard possède une densité d’entités (noms propres, outils, marques) de 5 à 8 %, les textes cités par ChatGPT grimpent à 20,6 %.

L’IA est par nature probabiliste. Un conseil générique (« utilisez un bon logiciel ») augmente la perplexité (la confusion) du modèle. À l’inverse, citer des outils spécifiques (« utilisez Salesforce, HubSpot ou Pipedrive ») fournit des points d’ancrage vérifiables. Nommer vos concurrents ou des partenaires technologiques réduit le risque algorithmique et renforce la crédibilité de votre contenu aux yeux de la machine.

6. La « Voix de l’analyste » et l’impératif du « Business-grade »

L’IA rejette les extrêmes. Sur une échelle de subjectivité de 0,0 (purement factuel) à 1,0 (pure opinion), les citations « gagnantes » se stabilisent à 0,47. C’est le juste milieu sémantique : une base de faits incontestables augmentée d’une analyse d’expert.

« Bien que l’iPhone 15 dispose d’une puce A16 standard (Fait), ses performances en photographie basse lumière en font un choix supérieur pour les créateurs de contenu (Analyse/Opinion). »

Par ailleurs, la complexité syntaxique est un tueur de visibilité. Les contenus cités affichent un score Flesch-Kincaid de 16 (niveau Bachelor), tandis que les contenus ignorés grimpent souvent à 19,1 (niveau PhD/Académique). Les phrases labyrinthiques et le jargon excessif ne sont pas perçus comme des signes d’intelligence, mais comme des obstacles à l’extraction de données. L’IA préfère la clarté du style « Business-grade » (type Harvard Business Review) à l’obscurité académique.

7. Payer la « taxe de clarté » pour l’avenir

L’ère du contenu « atmosphérique » est révolue. Pour exister dans les réponses des LLM, le contenu doit désormais se présenter comme un briefing structuré. Cette transformation impose une « taxe de clarté » : le sacrifice volontaire des fioritures narratives au profit d’une architecture de données accessible.

L’ironie de cette évolution est profonde. En nous forçant à satisfaire les contraintes architecturales des robots — rapidité de scan, densité d’information, langage direct — l’IA nous contraint à redécouvrir ce que les lecteurs humains, pressés et saturés, réclamaient déjà.

La question n’est plus de savoir si nous écrivons pour les machines, mais de réaliser que les robots nous forcent enfin à devenir les rédacteurs que les humains méritent. Êtes-vous prêt à payer la taxe de clarté ?